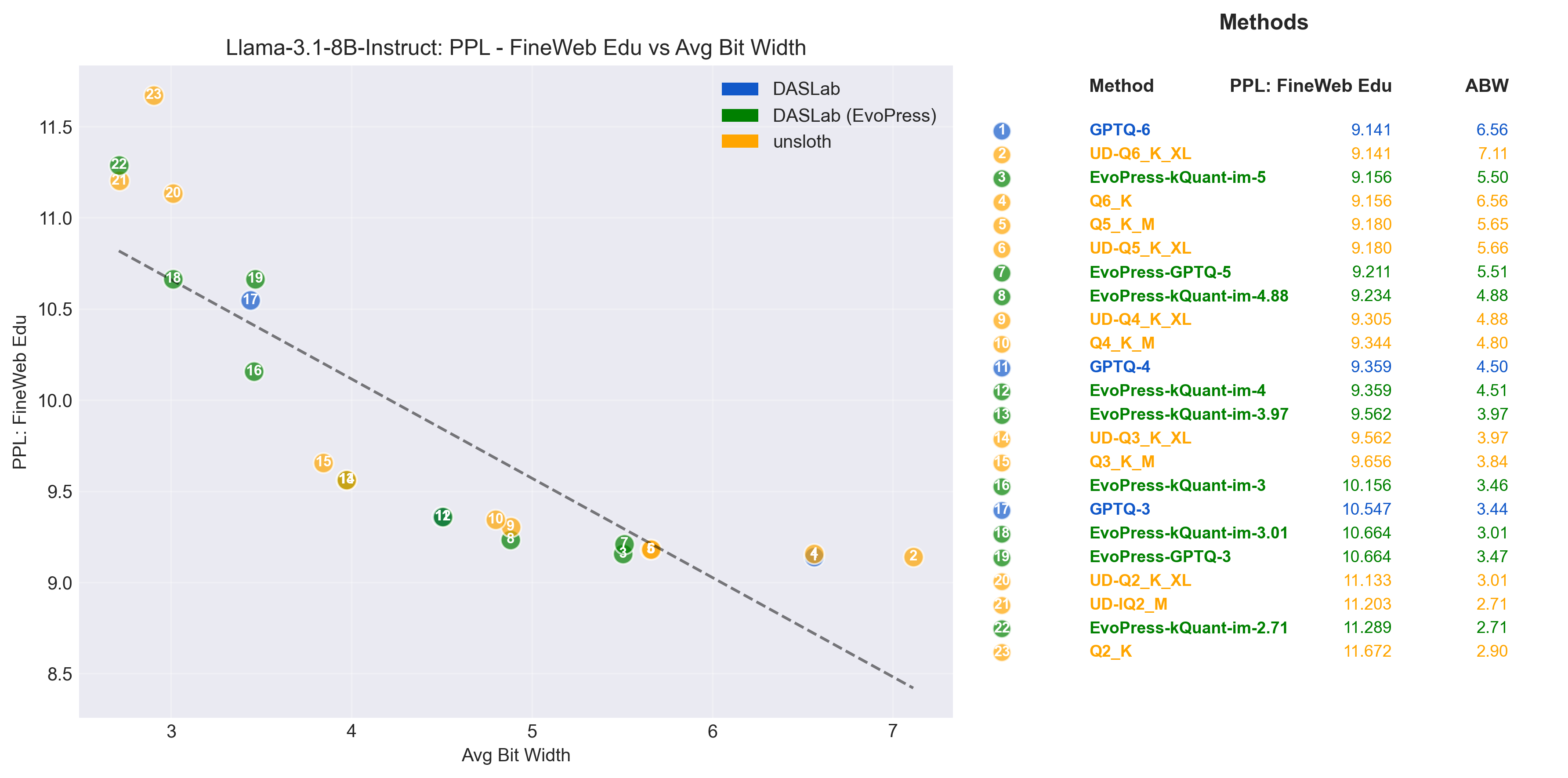

gptq-gguf-toolkit 是一款专门的计算工具,旨在对深度学习模型(特别是 GGUF (GGML 通用文件格式) 的模型)执行高效的非均匀量化。该工具包的核心是利用 GPTQ(生成式预训练 Transformer 量化)技术,这是一种先进的训练后量化方法,可在对准确性影响最小的情况下,显著减小大型模型的体积并加速其推理过程。GGUF 格式进一步优化了这些模型,以便在 CPU 上高效执行,使其非常适合部署在资源受限的环境中。

在大型 AI 模型的部署和高效运行至关重要的各种科学和工程领域,该工具都有着关键应用。它解决了与计算资源效率相关的根本性挑战,包括内存占用、推理速度和能耗。例如,在深度学习研究中,该工具包使研究人员能够通过实验量化复杂的神经网络(如 GoogleNet 架构),方法是将不同层选择性地量化到不同的位宽(例如,将瓶颈层量化为 4 位,同时将空间卷积层保持在 8 位),并精确估计由此导致的精度下降。这使得在无需大量重新训练的情况下进行精确优化成为可能。

在计算机组成与体系结构领域,该工具包对于理解不同量化方案的实际影响非常有价值,例如在梯度累积过程中,比较用于处理整数核中负权重的有符号整数表示(如补码)。其功能在医学信息学和人工智能安全领域尤为重要,在这些领域,将大型语言模型(LLM)部署于临床应用需要高度优化的模型。gptq-gguf-toolkit 有助于降低 LLM 在受限硬件(如旧款移动设备或医疗保健环境中的边缘计算平台)上的推理速度和内存需求。它还支持评估与设备端部署相关的权衡,包括对不同设备类别在准确性、校准和公平性方面的影响,这些都是道德 AI 部署的关键考量因素。通过实现高效的模型部署,此工具包加速了强大的科学智能(AI for Science)应用在现实世界场景中的开发和普及。

工具构建参数

| 主要语言 | Python |

| 构建系统 | None (source clone, no setup.py/pyproject) |